Innen vitenskapelig avbildning, enten det er i mikroskopi, astronomi eller halvlederinspeksjon, er oppløsning et grunnleggende konsept som direkte påvirker kvaliteten og nytten av dataene som samles inn. Enkelt sagt bestemmer oppløsning et avbildningssystems evne til å skille fine detaljer i et objekt.

Høy oppløsning lar forskere observere subtile strukturer, oppdage mindre defekter eller ta presise målinger, mens lav oppløsning kan skjule kritisk informasjon. Å forstå oppløsning krever mer enn bare å telle piksler. Faktorer som optikk, belysning og sensorytelse bidrar alle til den effektive oppløsningen til et system.

Hva er oppløsning i vitenskapelig avbildning?

Innen forbrukerfotografering, data- og smarttelefonskjermer og videostrømming refererer begrepet «oppløsning» vanligvis til antall piksler. Begreper som «720p», «1080p» og «4K» definerer oppløsning ved antall horisontale rader med piksler, mens beskrivelsen av et smarttelefonkamera som «20MP» innebærer at det har 20 millioner piksler.

Innen vitenskapelig avbildning betyr imidlertid begrepet «oppløsning» noe annet og spesifikt. Nemlig evnen til å optisk «løse» fine romlige detaljer i bildet fra hverandre. Dette avhenger av både det optiske oppsettet og pikselstørrelsen på kameraet som brukes. Under denne definisjonen er detsynsfelt– ikke oppløsning – som er definert av pikselantallet til kamerasensoren vår.

På et visst nivå blir all lysinformasjon som fanges opp av et kamera «uskarpt» av diffraksjon og aberrasjoner – enten dette skyldes ufullkommen optikk eller fysiske begrensninger på grunn av lysets bølgelengde, finnes det en grense for hvordan vi kan fange opp detaljer, noe som betyr at den perfekte «grunnsannheten» for alltid er utenfor vår rekkevidde. Den optiske oppløsningen er det minste detaljnivået som faktisk er bevart.

Videre er ikke pikslene i kameraet vårt uendelig små – over en viss lengdeskala vil bilder bli «pikselerte». Denne tilleggsfaktoren, «kameraoppløsningen», samhandler med den optiske oppløsningen for å definere den totale oppløsningen til systemet vårt.

Definere optisk oppløsning – diffraksjonsbegrenset oppløsning

Hvis vi hadde en perfekt linse, uten defekter, avvik eller designfeil, ville vi være i stand til å oppløse enhver detalj, uansett hvor liten den var? I virkeligheten, uansett kvaliteten på linsen vår, vil fysikken til lysbølger sette en øvre grense for oppløsningsevnen til linser og mikroskopobjektiver.

Lysdiffraksjon forårsaker uskarphet på en lengdeskala som avhenger av bølgelengden til lyset som brukes, og blenderåpningsstørrelsen til linsene som brukes til belysning og avbildning. Hvis en uendelig liten, men lyssterk «punktkilde» av lys ble avbildet av en linse, ville det resulterende bildet bli uskarpt til en karakteristisk form kalt den luftige disken vist i figur 1.

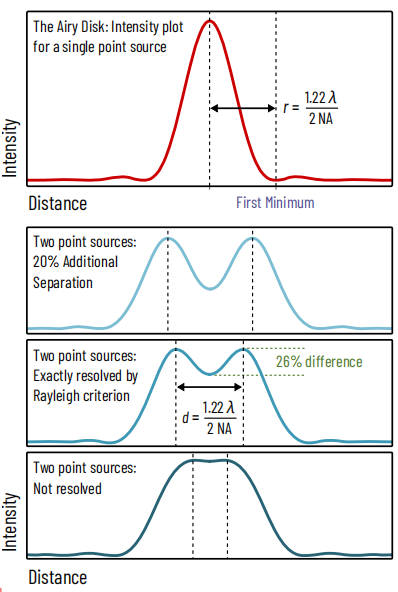

Figur 1: Definere oppløsning: Rayleigh-kriteriet

En punktlyskilde spres av optiske komponenter for å danne et bilde kjent som den «luftige skiven». I mikroskopi bestemmes størrelsen på denne skiven av lysets bølgelengde og objektivets numeriske apertur (i reflektert lysmodus, f.eks. fluorescens).

Rayleigh-kriteriet for om to punktkilder er oppløste, er oppfylt hvis avstanden mellom dem er minst avstanden til det første minimumet av den luftige skiven, og kontrastforholdet mellom toppene og det sentrale bunnen er minst 26 %.

Rayleigh-kriteriet

Definisjonen av diffraksjonsbegrenset oppløsning er da «hvor nær kan to punktlignende lyskilder komme hverandre før de ikke lenger kan skilles (oppløses) som to separate punkter?» Dette er vist i figur 1.

Det finnes en rekke matematiske konvensjoner for nøyaktig hvor denne linjen skal trekkes, men den mest brukte er Rayleigh-kriteriet, der toppen av ett punkt sammenfaller med det første minimumet av diffraksjonsmønsteret til det andre punktet. Dette tilsvarer et kontrastforhold på 26 % mellom intensiteten til toppene og bunnen mellom dem.

I romlige termer kan den minste oppløselige lengdeskalaen defineres som en minimumsavstand mellom punkter, eller i vinkelmessige termer som en minimumsvinkel i forhold til den optiske aksen til en linse.

Punktspredningsfunksjonen (PSF)

Den faktiske formen på et diffraksjonsmønster for en punktlyskilde når det er avbildet av et optisk oppsett kallespunktspredningsfunksjon(PSF). I avansert mikroskopi måles dette ofte i tre dimensjoner. Formen på PSF kan påvirkes av hvert optiske element i lysbanen, og å minimere størrelsen for å maksimere oppløsningsevnen er et vanlig mål for optiske ingeniører.

Noen analyseteknikker, som dekonvolusjon, krever vanligvis den tredimensjonale formen til PSF-en som input. I tillegg kan formen på PSF-en bevisst endres for å kode tilleggsinformasjon, for eksempel den vertikale (z-aksen) posisjonen til punktet, i et felt kjent som PSF-teknikk.

Definere optisk oppløsning – Begrensninger i linsekvalitet: MTF og CTF

I praksis for mange optiske systemer, spesielt for linsebasert avbildning, er den diffraksjonsbegrensede oppløsningen som ble introdusert ovenfor et «best case»-scenario som bare kan nås med linser av høyeste kvalitet. Andre faktorer, inkludert en lang liste over vanlige optiske avvik, og hvor nøyaktig linseprodusentene klarte å matche den tiltenkte presise matematiske linseformen, reduserer denne oppløsningsevnen. Oppløsning defineres deretter vanligvis eksperimentelt basert på målt kontrast ved forskjellige lengdeskalaer, eller ved simulering og teoretisk beregning som tar hensyn til hvert linseelement.

Den vanligste matematiske representasjonen av oppløsning i dette tilfellet er den optiske overføringsfunksjonen (OTF), som består av modulasjonsoverføringsfunksjonen (MTF) og faseoverføringsfunksjonen (PTF). MTF representerer hvor mye kontrast som kan leveres av linsen eller det optiske systemet ved forskjellige lengdeskalaer eller romlige frekvenser. PTF vil ikke bli undersøkt her; avbildningsfaseinformasjon krever spesialiserte optiske oppsett og kan neglisjeres for konvensjonell avbildning. MTF kan beregnes for teoretiske linser og optiske oppsett. Det kan imidlertid være vanskelig å måle i praksis.

I stedet kan en enklere tilnærming brukes for testing av optiske komponenter i den virkelige verden, ved å måle den såkalte kontrastoverføringsfunksjonen (CTF).

CTF- og MTF-grafer

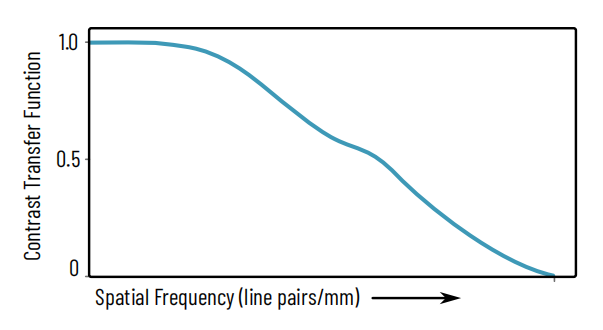

Figur 2: Eksempel på en CTF-kurve

Kontrastoverføringsfunksjon (CTF) er et numerisk mål på mengden kontrast som passerer gjennom et optisk system. X-akse: romlig frekvens i linjepar/mm, økende fra venstre mot høyre. Reelle CTF- og MTF-målinger inkluderer vanligvis flere forskjellige kurver som korresponderer med forskjellige måleforhold, for eksempel radiale vs. parallelle målelinjer, horisontale/vertikale linjer, forskjellige linseinnstillinger osv.

CTF-en til en linse er en komplisert funksjon som påvirkes av hvert optiske element i den optiske banen, og kan måles for hver linse, kamerasensoren eller for hele det optiske systemet. Den typiske formen for plottet er vist i figur 2.

X-aksen er vanligvis representert i «linjepar per mm», som refererer til hvor vellykket den testede komponenten kan reprodusere et par linjer, en lys og en mørk, ved den gitte romlige frekvensen. Det inverse av dette tallet vil gi tykkelsen på linjeparet. På Y-aksen er CTF, som er et forhold mellom kontrasten mellom linjene som går inn i linsen kontra linjene som kommer ut av den, som i ligning 1, med kontrast definert som i ligning 2.

Faktorer som påvirker MTF/CTF

Tenk deg for eksempel en sekvens av linjepar med lyse linjer avgrenset av mørke linjer som bare var 20 % like lyse. Kontrasten i dette tilfellet ville være 66 % i henhold til ligning 6. Hvis de lyse linjene, ved passasje gjennom en linse, ble spredt ut av diffraksjon og aberrasjoner slik at mørke linjer nå var 50 % av intensiteten til de lyse linjene, ville kontrasten nå være 33 %, og CTF ville være 33 %/66 % = 50 %. I de fleste tilfeller, jo høyere romfrekvens i lp/mm, desto lavere er CTF – selv om kurven ikke alltid er monoton (jevt avtagende).

MTF-en til et typisk kameraobjektiv er avhengig av flere faktorer, derfor plottes det vanligvis flere grafer for å karakterisere ett objektiv. Faktorer inkluderer blenderåpningsstørrelse (f.eks. f/4, f/8 osv.), avstand fra midten av objektivet, og om linjeparene som måles er parallelle med pikselnettet til kamerasensoren, slik det er undersøkt for diffraksjonsbegrenset oppløsning.

Til syvende og sist kan svaret på spørsmålet «gir denne linse-/sensorkombinasjonen nok oppløsning for mitt bruksområde» kreve eksperimentell testing og benchmarking.

Romlig frekvens: Måling av detaljer

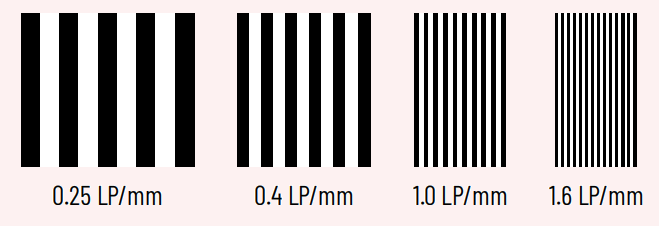

Figur 3: Eksempel på økende romlig frekvens i linjepar / mm

Romfrekvens er et konsept som ofte brukes i diskusjoner om oppløsning. Det refererer ganske enkelt til «hvor mange funksjoner som finnes per enhetsavstand», f.eks. et repeterende mønster av linjer som ligger tett inntil hverandre. Det måles vanligvis i enheter med invers avstand, for eksempel m⁻¹, selv om inverse millimeter mm⁻¹ i praksis er identisk med linjepar per mm (lp/mm). Romfrekvens er direkte analog med den «tidsmessige» frekvensen til lys- eller lydbølger, bortsett fra at den måles per enhetsavstand, snarere enn tid.

Oppløsning, kontrast og SNR (signal-til-støy-forhold)

Det er viktig å huske at beregninger og målinger av oppløsning er et «best-case»-scenario. Definisjonen av oppløsning ovenfor er avhengig av bildekontrast. Å oppnå kontrasten som kreves for å oppløse fine detaljer er ikke bare avhengig av optisk og kameraoppløsning, men også avsignal-til-støy-forhold(SNR), bakgrunnslys, bildekvalitet og andre faktorer.

Det er også verdt å merke seg at faktorer som forbedrer optisk oppløsning ofte også kan forbedre andre viktige faktorer – for eksempel resulterer økning av mikroskopobjektiv eller linseåpning også i mer lysinnsamling, noe som vanligvis forbedrer signal-til-støy-forholdet. For fluorescensavbildning med et mikroskopobjektiv avhenger lysstyrken til det innsamlede lyset faktisk av numerisk blenderåpning opphøyd i fjerde potens, noe som betyr at en liten økning i NA kan føre til en betydelig forbedring av bildets lysstyrke.

Viktige faktorer som påvirker oppløsningen i vitenskapelig avbildning

Utover de teoretiske grensene formes praktisk oppløsning av flere gjensidig avhengige faktorer:

1. Linsekvalitet og avvik

● Aberrasjonskorreksjon (apokromatiske linser, adaptiv optikk) er viktig for høyoppløselig bildebehandling.

● Dårlig linsekvalitet reduserer MTF og utvider PSF.

2. Numerisk blenderåpning (NA)

● Linser med høyere NA fanger opp mer diffraktert lys og forbedrer oppløsningen.

● NA er begrenset av fysisk design og brytningsindeksen til avbildningsmediet.

3. Belysningens bølgelengde

● Kortere bølgelengder (f.eks. blått lys) gir høyere oppløsning.

● Teknikker som superoppløsningsmikroskopi utnytter dette prinsippet ved å manipulere effektive bølgelengdegrenser.

4. Sensoregenskaper

● Pikselstørrelse: Mindre piksler kan sample finere detaljer, men bare hvis optikken gir tilstrekkelig oppløsning (Nyquist-samplingskriterium).

● Kvanteeffektivitet: Høyere QE forbedrer signal-støyforholdet (SNR) og avslører finere detaljer.

● Les støy og mørkstrøm: Sensorer med lavt støynivå bevarer kontrasten ved høye romfrekvenser.

5. Belysning og prøveforhold

● Ujevn eller svak belysning reduserer kontrasten.

● Prøveforberedelse, farging eller merking kan direkte påvirke evnen til å separere strukturer.

Konklusjon

Oppløsning er en hjørnestein i vitenskapelig avbildning. Den definerer et systems evne til å skille fine detaljer, og påvirker alt fra mikroskopi til halvlederinspeksjon. Selv om megapiksler ofte dominerer den offentlige oppfatningen, bestemmes den sanne oppløsningen av en kombinasjon av optikk, diffraksjon, sensoregenskaper og bildekvalitetsfaktorer som kontrast og signal-støy-forhold (SNR).

Ved å forstå konsepter som punktspredningsfunksjonen, MTF, romlig frekvens og de fysiske grensene som diffraksjon pålegger, kan forskere ta informerte valg om bildesystemer, optimalisere eksperimentelle oppsett og tolke resultater nøyaktig. Til syvende og sist er det viktig å mestre oppløsning for å oppnå meningsfulle vitenskapelige bilder av høy kvalitet.

Tucsen Photonics Co., Ltd. Alle rettigheter forbeholdt. Vennligst oppgi kilden ved sitering:www.tucsen.com

2025/10/20

2025/10/20