W obrazowaniu naukowym, czy to w mikroskopii, astronomii, czy inspekcji półprzewodników, rozdzielczość jest fundamentalną koncepcją, która bezpośrednio wpływa na jakość i użyteczność rejestrowanych danych. Mówiąc prościej, rozdzielczość określa zdolność systemu obrazowania do rozróżniania drobnych szczegółów obiektu.

Wysoka rozdzielczość pozwala badaczom obserwować subtelne struktury, wykrywać drobne defekty lub wykonywać precyzyjne pomiary, podczas gdy niska rozdzielczość może utrudniać dostęp do kluczowych informacji. Zrozumienie rozdzielczości wymaga czegoś więcej niż tylko liczenia pikseli. Czynniki takie jak optyka, oświetlenie i wydajność czujnika wpływają na efektywną rozdzielczość systemu.

Czym jest rozdzielczość w obrazowaniu naukowym?

W fotografii konsumenckiej, na ekranach komputerów i smartfonów oraz w streamingu wideo termin „rozdzielczość” zazwyczaj odnosi się do liczby pikseli. Terminy takie jak „720p”, „1080p” i „4K” definiują rozdzielczość na podstawie liczby poziomych rzędów pikseli, podczas gdy opisanie aparatu w smartfonie jako „20 MP” sugeruje, że ma on 20 milionów pikseli.

W obrazowaniu naukowym termin „rozdzielczość” oznacza jednak coś innego i specyficznego. Mianowicie zdolność optycznego „oddzielania” od siebie drobnych szczegółów przestrzennych obrazu. Zależy to zarówno od konfiguracji optycznej, jak i rozmiaru pikseli używanej kamery. Zgodnie z tą definicją,pole widzenia– nie rozdzielczość – która jest definiowana przez liczbę pikseli w czujniku naszego aparatu.

Na pewnym poziomie wszystkie informacje świetlne rejestrowane przez kamerę są „rozmyte” przez dyfrakcję i aberracje – niezależnie od tego, czy wynika to z niedoskonałości optyki, czy z ograniczeń fizycznych wynikających z długości fali światła, istnieją ograniczenia w rejestrowaniu szczegółów, co oznacza, że idealna „prawda na ziemi” jest na zawsze poza naszym zasięgiem. Rozdzielczość optyczna to najmniejszy poziom szczegółowości, który jest faktycznie zachowywany.

Co więcej, piksele naszego aparatu nie są nieskończenie małe – powyżej pewnej kluczowej skali długości obrazy będą „pikselowane”. Ten dodatkowy czynnik, „rozdzielczość aparatu”, współdziała z rozdzielczością optyczną, definiując ogólną rozdzielczość naszego systemu.

Definicja rozdzielczości optycznej – rozdzielczość ograniczona dyfrakcją

Gdybyśmy mieli idealną soczewkę, bez defektów, aberracji i wad konstrukcyjnych, czy bylibyśmy w stanie rozróżnić każdy szczegół, nawet najmniejszy? W rzeczywistości, niezależnie od jakości naszej soczewki, fizyka fal świetlnych wyznacza górną granicę zdolności rozdzielczej soczewek i obiektywów mikroskopowych.

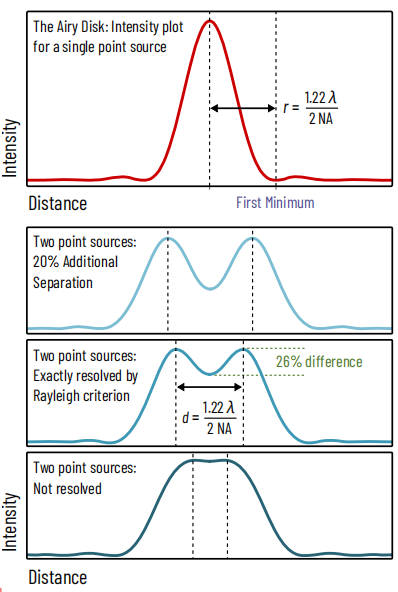

Dyfrakcja światła powoduje rozmycie w skali długości, która zależy od długości fali użytego światła oraz średnicy apertury soczewek użytych do oświetlenia i obrazowania. Gdyby nieskończenie małe, ale jasne „punktowe źródło” światła zostało zobrazowane przez soczewkę, powstały obraz uległby rozmyciu, tworząc charakterystyczny kształt zwany dyskiem Airy'ego, pokazany na rysunku 1.

Rysunek 1: Definicja rozdzielczości: kryterium Rayleigha

Punktowe źródło światła jest rozpraszane przez elementy optyczne, tworząc obraz znany jako „dysk powietrzny”. W mikroskopii rozmiar tego dysku jest określany przez długość fali światła i aperturę numeryczną obiektywu (w trybie światła odbitego, np. fluorescencji).

Kryterium Rayleigha dotyczące rozróżnienia dwóch źródeł punktowych jest spełnione, jeżeli odległość między nimi jest co najmniej równa odległości do pierwszego minimum dysku powietrznego, a współczynnik kontrastu między szczytami a centralną doliną wynosi co najmniej 26%.

Kryterium Rayleigha

Definicja rozdzielczości ograniczonej dyfrakcją brzmi następująco: „Jak blisko siebie mogą znaleźć się dwa punktowe źródła światła, zanim nie będzie można ich odróżnić (rozdzielić) jako dwa oddzielne punkty?”. Zjawisko to pokazano na rysunku 1.

Istnieje wiele konwencji matematycznych określających dokładny przebieg tej linii, ale najczęściej stosowaną jest kryterium Rayleigha, zgodnie z którym szczyt jednego punktu pokrywa się z pierwszym minimum obrazu dyfrakcyjnego drugiego punktu. Odpowiada to współczynnikowi kontrastu 26% między intensywnością szczytów a doliną między nimi.

W ujęciu przestrzennym minimalną rozróżnialną skalę długości można zdefiniować jako minimalną odległość między punktami, a w ujęciu kątowym jako minimalny kąt względem osi optycznej soczewki.

Funkcja rozproszenia punktowego (PSF)

Rzeczywisty kształt wzoru dyfrakcyjnego dla punktowego źródła światła, po jego zobrazowaniu przez układ optyczny, nazywa sięfunkcja rozproszenia punktowego(PSF). W zaawansowanej mikroskopii jest to często mierzone w trzech wymiarach. Na kształt PSF może wpływać każdy element optyczny na drodze światła, a minimalizacja jego rozmiaru w celu maksymalizacji zdolności rozdzielczej jest powszechnym celem inżynierów optycznych.

Niektóre techniki analityczne, takie jak dekonwolucja, zazwyczaj wymagają jako danych wejściowych trójwymiarowego kształtu funkcji PSF. Ponadto kształt funkcji PSF można celowo zmienić, aby zakodować dodatkowe informacje, takie jak położenie punktu w pionie (na osi Z), w dziedzinie znanej jako inżynieria funkcji PSF.

Definicja rozdzielczości optycznej – ograniczenia jakości obiektywu: MTF i CTF

W praktyce, w przypadku wielu systemów optycznych, zwłaszcza w przypadku obrazowania opartego na soczewkach, opisana powyżej rozdzielczość ograniczona dyfrakcją to „najlepszy” scenariusz, osiągalny jedynie przez obiektywy najwyższej jakości. Inne czynniki, w tym długa lista typowych aberracji optycznych oraz dokładność, z jaką producenci soczewek byli w stanie odtworzyć zamierzony, precyzyjny, matematyczny kształt soczewki, obniżają tę zdolność rozdzielczą. Rozdzielczość jest zazwyczaj definiowana eksperymentalnie na podstawie pomiaru kontrastu w różnych skalach długości lub poprzez symulację i obliczenia teoretyczne, uwzględniające każdy element soczewki.

Najczęstszym matematycznym przedstawieniem rozdzielczości w tym przypadku jest funkcja przenoszenia optycznego (OTF), składająca się z funkcji przenoszenia modulacji (MTF) i funkcji przenoszenia fazy (PTF). Funkcja MTF określa, ile kontrastu może dostarczyć obiektyw lub układ optyczny w różnych skalach długości lub częstotliwościach przestrzennych. Funkcja PTF nie będzie tutaj omawiana; informacje o fazie obrazowania wymagają specjalistycznych układów optycznych i mogą być pomijane w przypadku obrazowania konwencjonalnego. Funkcja MTF może być obliczona dla obiektywów teoretycznych i układów optycznych. Jednak jej pomiar w praktyce może być trudny.

Zamiast tego, do testowania elementów optycznych w warunkach rzeczywistych można zastosować prostsze podejście polegające na pomiarze tzw. funkcji przenoszenia kontrastu (CTF).

Wykresy CTF i MTF

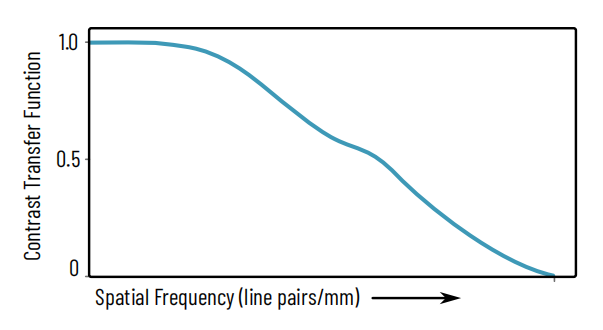

Rysunek 2: Przykład krzywej CTF

Funkcja przenoszenia kontrastu (CTF) to numeryczna miara ilości kontrastu przechodzącego przez układ optyczny. Oś X: częstość przestrzenna w parach linii/mm, rosnąca od lewej do prawej. Rzeczywiste pomiary CTF i MTF zazwyczaj obejmują wiele różnych krzywych odpowiadających różnym warunkom pomiaru, takim jak linie docelowe promieniowe i równoległe, linie poziome/pionowe, różne ustawienia obiektywu itp.

Współczynnik CTF soczewki to złożona funkcja, na którą wpływa każdy element optyczny na ścieżce optycznej i którą można zmierzyć dla każdej soczewki, matrycy aparatu lub całego układu optycznego. Typowy wykres przedstawiono na rysunku 2.

Oś X jest zazwyczaj przedstawiana w „parach linii na mm”, co odnosi się do tego, jak skutecznie testowany komponent może odtworzyć parę linii, jedną jasną i jedną ciemną, przy danej częstotliwości przestrzennej. Odwrotność tej liczby dałaby grubość pary linii. Na osi Y znajduje się współczynnik CTF, czyli stosunek kontrastu między liniami wchodzącymi do soczewki a liniami wychodzącymi z niej, jak w równaniu 1, przy czym kontrast jest zdefiniowany jak w równaniu 2.

Czynniki wpływające na MTF/CTF

Rozważmy na przykład sekwencję par linii z jasnymi liniami otoczonymi przez linie ciemne, które były jaśniejsze tylko o 20%. Kontrast w tym przypadku wyniósłby 66% zgodnie z równaniem 6. Gdyby po przejściu przez soczewkę jasne linie rozproszyły się wskutek dyfrakcji i aberracji tak, że teraz ciemne linie stanowiłyby 50% intensywności linii jasnych, kontrast wyniósłby 33%, a współczynnik CTF wyniósłby 33%/66% = 50%. W większości przypadków im wyższa częstość przestrzenna w lp/mm, tym niższy współczynnik CTF – choć krzywa nie zawsze jest monotoniczna (płynnie malejąca).

Wartość MTF typowego obiektywu fotograficznego zależy od wielu czynników, dlatego zazwyczaj sporządza się wiele wykresów charakteryzujących jeden obiektyw. Czynniki te obejmują rozmiar przysłony (np. f/4, f/8 itd.), odległość od środka obiektywu oraz to, czy zmierzone pary linii są równoległe do siatki pikseli matrycy aparatu, co jest badane pod kątem rozdzielczości ograniczonej dyfrakcją.

Ostatecznie odpowiedź na pytanie „czy ta kombinacja obiektywu i czujnika zapewnia wystarczającą rozdzielczość dla mojego zastosowania” może wymagać testów eksperymentalnych i testów porównawczych.

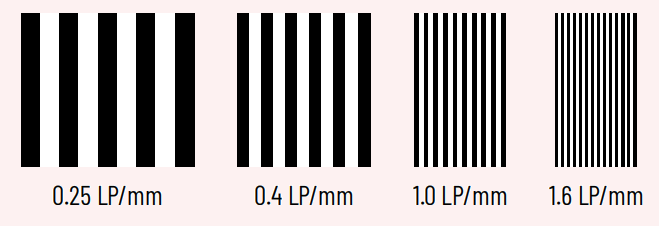

Częstotliwość przestrzenna: pomiar szczegółów

Rysunek 3: Przykład wzrostu częstotliwości przestrzennej w parach linii / mm

Częstotliwość przestrzenna to pojęcie powszechnie używane w dyskusjach na temat rozdzielczości. Odnosi się ono po prostu do „liczby cech przypadającej na jednostkę odległości”, np. powtarzającego się wzoru blisko siebie położonych linii. Zwykle mierzy się ją w jednostkach odwrotności odległości, na przykład m-1, chociaż odwrotność milimetrów mm-1 w praktyce jest identyczna z liczbą par linii na mm (lp/mm). Częstotliwość przestrzenna jest bezpośrednio analogiczna do częstotliwości „czasowej” fal świetlnych lub dźwiękowych, z tą różnicą, że mierzy się ją na jednostkę przestrzeni, a nie czasu.

Rozdzielczość, kontrast i SNR (stosunek sygnału do szumu)

Należy pamiętać, że obliczenia i pomiary rozdzielczości są oparte na „najlepszym” scenariuszu. Powyższa definicja rozdzielczości opiera się na kontraście obrazu. Osiągnięcie kontrastu wymaganego do uchwycenia drobnych szczegółów zależy nie tylko od rozdzielczości optycznej i aparatu, ale także od…stosunek sygnału do szumu(SNR), oświetlenie tła, jakość obrazu i inne czynniki.

Warto również zauważyć, że czynniki poprawiające rozdzielczość optyczną często mogą również poprawić inne ważne czynniki – na przykład zwiększenie obiektywu lub apertury obiektywu mikroskopu skutkuje również większym zbieraniem światła, co zazwyczaj poprawia stosunek sygnału do szumu. W przypadku obrazowania fluorescencyjnego z obiektywem mikroskopu jasność zbieranego światła zależy od apertury numerycznej do czwartej potęgi, co oznacza, że niewielki wzrost apertury NA może prowadzić do znacznej poprawy jasności obrazu.

Kluczowe czynniki wpływające na rozdzielczość w obrazowaniu naukowym

Poza ograniczeniami teoretycznymi, na praktyczne rozwiązania wpływa kilka współzależnych czynników:

1. Jakość obiektywu i aberracje

● Korekcja aberracji (soczewki apochromatyczne, optyka adaptacyjna) jest niezbędna do obrazowania o wysokiej rozdzielczości.

● Słaba jakość obiektywu obniża MTF i rozszerza PSF.

2. Apertura numeryczna (NA)

● Soczewki o wyższej liczbie NA wychwytują więcej rozproszonego światła i poprawiają rozdzielczość.

● NA jest ograniczone przez konstrukcję fizyczną i współczynnik załamania światła ośrodka obrazującego.

3. Długość fali oświetlenia

● Krótsze długości fal (np. światło niebieskie) zapewniają wyższą rozdzielczość.

● Techniki takie jak mikroskopia superrozdzielcza wykorzystują tę zasadę poprzez manipulowanie efektywnymi limitami długości fal.

4. Charakterystyka czujnika

● Rozmiar piksela: Mniejsze piksele mogą próbkować drobniejsze szczegóły, ale tylko jeśli optyka zapewnia wystarczającą rozdzielczość (kryterium próbkowania Nyquista).

● Wydajność kwantowa: Wyższy współczynnik QE poprawia stosunek sygnału do szumu, ujawniając drobniejsze szczegóły.

● Szum odczytu i prąd ciemny: Czujniki o niskim poziomie szumów zachowują kontrast przy wysokich częstotliwościach przestrzennych.

5. Oświetlenie i warunki próbki

● Nierównomierne lub słabe oświetlenie zmniejsza kontrast.

● Przygotowanie próbki, barwienie lub znakowanie może bezpośrednio wpływać na możliwość rozróżniania struktur.

Wniosek

Rozdzielczość jest kamieniem węgielnym obrazowania naukowego. Określa ona zdolność systemu do rozróżniania drobnych szczegółów, wpływając na wszystko, od mikroskopii po inspekcję półprzewodników. Chociaż megapiksele często dominują w powszechnej opinii, rzeczywista rozdzielczość jest determinowana przez połączenie optyki, dyfrakcji, charakterystyki czujnika oraz czynników jakości obrazu, takich jak kontrast i SNR.

Rozumiejąc takie koncepcje, jak funkcja rozproszenia punktu (PDF), MTF, częstotliwość przestrzenna oraz ograniczenia fizyczne narzucane przez dyfrakcję, naukowcy mogą podejmować świadome decyzje dotyczące systemów obrazowania, optymalizować konfiguracje eksperymentalne i dokładnie interpretować wyniki. Ostatecznie, opanowanie rozdzielczości jest kluczowe dla uzyskania wysokiej jakości, wiarygodnych obrazów naukowych.

Tucsen Photonics Co., Ltd. Wszelkie prawa zastrzeżone. Przy cytowaniu prosimy o podanie źródła:www.tucsen.com

2025/10/20

2025/10/20