Die Bildrate einer Kamera beschreibt, wie viele Bilder eine Kamera pro Sekunde aufnehmen kann, und gilt bei der Bewertung von Hochgeschwindigkeits-Bildgebungssystemen oft als wichtigstes Kriterium. In dynamischen Experimenten, Inspektionsabläufen oder schnellen biologischen Prozessen bestimmt die Bildrate direkt, wie viele zeitliche Details erfasst werden können.

Die angegebene maximale Bildrate ist jedoch kein fester Wert. Sie hängt von der Sensorarchitektur, dem relevanten Bildausschnitt (ROI), der Belichtungszeit, dem Auslesemodus und der Bandbreite der Datenschnittstelle ab. In der Praxis ist die erreichbare Bildrate das Ergebnis mehrerer interagierender Faktoren. Um diese Faktoren zu verstehen, muss man über die Bilder pro Sekunde hinausblicken und untersuchen, wie die Bildzeit innerhalb des Kamerasystems konstruiert wird.

Was ist die Bildrate einer Kamera?

Die Bildrate einer Kamera bezeichnet die Anzahl der Bilder, die eine Kamera unter definierten Betriebsbedingungen pro Sekunde aufnehmen kann. Sie wird üblicherweise in Bildern pro Sekunde (FPS) angegeben und beschreibt, wie schnell aufeinanderfolgende Bilder erfasst und zur Verarbeitung oder Speicherung bereitgestellt werden können.

Die Bildrate bestimmt die zeitliche Auflösung eines Bildgebungssystems. In dynamischen Anwendungen – wie der Partikelverfolgung, der Hochgeschwindigkeitsinspektion oder der Beobachtung sich schnell ändernder biologischer Prozesse – ermöglichen höhere Bildraten eine detailliertere Beobachtung von Bewegungen und vorübergehenden Ereignissen.

Die Bildrate ist jedoch keine isolierte Größe. Die maximal erreichbare Bildrate hängt vom Kameramodus, dem Aufnahmebereich (ROI), der Belichtungszeit, der Farbtiefe und der Schnittstellenbandbreite ab. Eine angegebene „maximale Bildrate“ setzt in der Regel bestimmte Bedingungen voraus, wie beispielsweise einen reduzierten Aufnahmebereich oder einen bestimmten Auslesemodus.

Um zu verstehen, was die Bildrate tatsächlich begrenzt, muss untersucht werden, wie lange es dauert, ein einzelnes Bild zu erfassen und auszulesen – die sogenannte Bildzeit –, was im nächsten Abschnitt näher erläutert wird.

Bildrate vs. Bildzeit vs. Zeilenzeit

Die Bildrate wird üblicherweise in Bildern pro Sekunde (FPS) angegeben, ist aber kein primärer physikalischer Parameter. Sie ist der Kehrwert der Zeit, die zum Erfassen und Auslesen eines einzelnen Bildes benötigt wird.

Bildrate = 1 / Bildzeit

Um zu verstehen, was die Bildrate bestimmt, müssen wir daher untersuchen, wie die Bildzeit konstruiert wird.

Woraus setzt sich die Framezeit zusammen?

Die Framezeit gibt die Gesamtzeit an, die zur Erzeugung eines vollständigen Bildes benötigt wird. In den meisten FällenCMOS-KamerasDies umfasst:

● Belichtungszeit (wie lange der Sensor Licht sammelt)

● Sensorauslesezeit (wie lange es dauert, Pixelwerte umzuwandeln und zu übertragen)

● Datenübertragungszeit (Schnittstellenübertragung zum Host-Computer)

Bei kurzer Belichtungszeit im Verhältnis zur Auslesezeit wird die Bildrate typischerweise durch den Ausleseprozess begrenzt. Bei langer Belichtungszeit kann diese hingegen zum dominierenden begrenzenden Faktor werden.

Leitungszeit – Die grundlegende Sensorbeschränkung

Bei CMOS-Sensoren ist die Zeilenlaufzeit der primäre interne Faktor, der die Bildrate begrenzt. Die Zeilenlaufzeit ist die Zeit, die eine Reihe von Analog-Digital-Wandlern (ADCs) benötigt, um eine Pixelzeile zu messen und zu digitalisieren.

In den meisten Architekturen wird jede Zeile sequenziell verarbeitet. Daher ergibt sich die gesamte Auslesezeit für einen Frame aus der Anzahl der aktiven Zeilen multipliziert mit der Zeilenzeit:

Frame-Lesezeit = Zeilenzeit × Anzahl der Zeilen

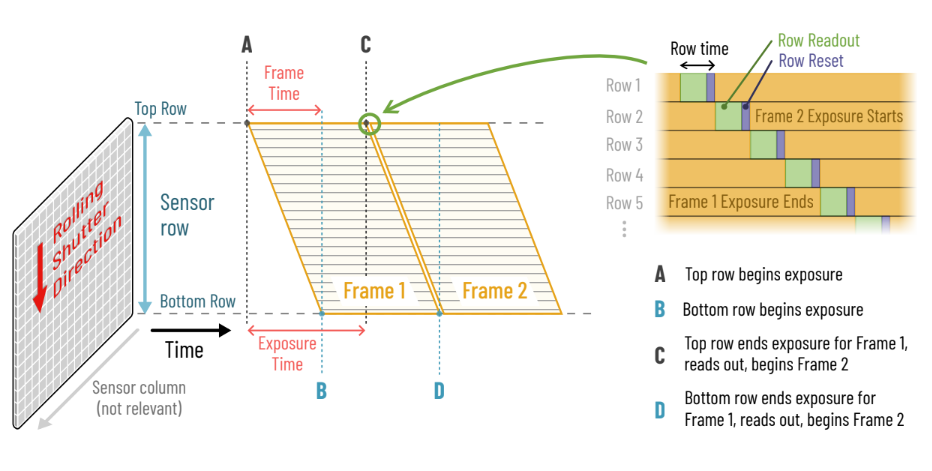

Abbildung 1: Einführung in die Zeitdiagramme des Rolling-Shutter-Effekts (Parallelogramm)

Links:Diagramm der Sensorzeile (y-Achse) über der Zeit (x-Achse), wobei gelbe Parallelogramme die Belichtung jeder Kamerazeile aufgrund der Wirkung des Rolling Shutter markieren.

Rechts:Eine Vergrößerung auf die Ebene der einzelnen Zeilen veranschaulicht die Rolle der Auslese- und Rückstellfunktionen bei der Bestimmung der Rolling-Shutter-Zeit.

Dies erklärt, warum die Verkleinerung des relevanten Bereichs (ROI) – insbesondere der Anzahl der Pixelzeilen – die Bildrate deutlich erhöhen kann. Durch die Halbierung der Zeilenanzahl halbiert sich annähernd die Auslesezeit, und die erreichbare Bildrate kann sich nahezu verdoppeln, vorausgesetzt, alle anderen Faktoren bleiben konstant.

Die Zeilenlaufzeit selbst kann je nach Auslesemodus variieren, ist aber innerhalb eines bestimmten Modus in der Regel fest.

Theoretische vs. reale Bildrate

Die in den Spezifikationen angegebene „maximale Bildrate“ wird üblicherweise allein aus der Einlesezeit der Bilder berechnet. In der Praxis kann die tatsächliche Bildrate aus folgenden Gründen niedriger sein:

● Längere Belichtungszeiten

● Längere Belichtungszeiten

● Beschränkungen der Schnittstellenbandbreite

● Software- oder Verarbeitungsverzögerungen

Aus diesem Grund ist es wichtig, zwischen der theoretisch maximalen Bildrate (FPS) und der unter Ihren tatsächlichen Betriebsbedingungen erreichbaren Bildrate zu unterscheiden.

Sensorfaktoren, die die Bildrate beeinflussen

Während die Zeilen- und Bildlesezeit die grundlegenden Zeitgrenzen eines Sensors definieren, können verschiedene konfigurierbare Parameter auf Kameraebene die erreichbare Bildrate erheblich beeinflussen.

Region von Interesse (ROI)

Die Anzahl der aktiven Pixelzeilen bestimmt direkt die Auslesezeit des Frames. Durch Verringern der Höhe des relevanten Bereichs verringert sich die Anzahl der auszulesenden Zeilen, wodurch sich die Auslesedauer verkürzt.

Da die Frame-Lesezeit annähernd proportional zur Zeilenanzahl ist, kann eine Halbierung der ROI-Höhe die maximal erreichbare Framerate nahezu verdoppeln – vorausgesetzt, Belichtungszeit und Schnittstellenbandbreite sind keine limitierenden Faktoren. Bei Anwendungen, die sich auf einen kleinen Bereich der Bewegungs- oder Detektion konzentrieren, ist die Verwendung von ROI oft der effektivste Weg zur Geschwindigkeitssteigerung.

Binning und Subsampling

Beim Pixel-Binning werden benachbarte Pixel vor dem Auslesen oder Digitalisieren zusammengefasst, wodurch die Ausgabeauflösung und das gesamte Datenvolumen effektiv reduziert werden. Je nach Sensorarchitektur kann Binning den Datendurchsatz verringern und mitunter die effektive Bildrate verbessern.

Allerdings reduziert Binning nicht immer die interne Zeilenlaufzeit. In vielen CMOS-Designs werden Zeilen auch dann noch sequenziell gelesen, wenn Pixel zusammengefasst werden. Daher kann Binning die Datenübertragungseffizienz verbessern, ohne die intrinsische Auslesezeit wesentlich zu verändern.

Bittiefe und Auslesemodi

Vielewissenschaftliche KamerasSie bieten mehrere Auslesemodi, wobei der Dynamikbereich oft gegen die Geschwindigkeit abgewogen wird. Beispielsweise kann ein 16-Bit-HDR-Modus geringes Ausleserauschen und eine hohe Speicherkapazität priorisieren, während ein 12-Bit-„Geschwindigkeitsmodus“ höhere Bildwiederholraten durch Reduzierung der Datengenauigkeit oder Änderung der Verstärkungseinstellungen erzielen kann.

Da eine höhere Bittiefe die Datenmenge pro Frame erhöht, kann der Wechsel zu einer niedrigeren Bittiefe die Datenübertragungslast verringern und in einigen Fällen höhere Frameraten ermöglichen – insbesondere wenn die Schnittstellenbandbreite ein begrenzender Faktor ist.

Wechselwirkung zwischen Belichtungszeit und Bildrate

Die Bildrate wird nicht allein durch die Auslesezeit des Sensors bestimmt. Auch die Belichtungsdauer kann die Geschwindigkeit der Bildaufnahme begrenzen.

Im Allgemeinen wird die maximal erreichbare Bildrate durch die längere der beiden Zeitkomponenten bestimmt: Belichtungszeit oder Auslesezeit. Ist die Belichtungszeit kürzer als die Auslesezeit, begrenzt die Auslesezeit die Bildrate. Übersteigt die Belichtungszeit jedoch die Auslesezeit, wird die Belichtung zum bestimmenden Faktor.

Bei vielen CMOS-Sensoren mit Rolling-Shutter-Technologie können Belichtung und Auslesen teilweise überlappen. Während eine Zeile ausgelesen wird, können andere Zeilen bereits Licht für das nächste Bild integrieren. Diese Überlappung ermöglicht eine kürzere Belichtungszeit als die vollständige Auslesezeit des Bildes, ohne die Bildrate zwangsläufig zu verringern.

Wenn die Belichtungszeit jedoch länger wird als die gesamte Auslesezeit des Sensors – beispielsweise bei Aufnahmen in schwachem Licht, die eine längere Integrationszeit erfordern –, sinkt die Bildrate proportional. In solchen Fällen:

Maximale Bildrate ≈ 1 / Belichtungszeit

Um die Aufnahmegeschwindigkeit zu optimieren, ist es entscheidend zu verstehen, ob Ihr System durch die Ausleseleistung oder die Belichtung begrenzt ist. Eine Erhöhung der Verstärkung, eine Verbesserung der Ausleuchtung oder eine Reduzierung der erforderlichen Integrationszeit können die Bildrate effektiver steigern als die alleinige Anpassung des ROI oder des Auslesemodus.

Schnittstellenbandbreite und Datendurchsatzbeschränkungen

Selbst wenn ein Sensor Bilder in hoher Geschwindigkeit auslesen kann, kann die Schnittstelle zwischen Kamera und Host-Computer zum limitierenden Faktor werden.

Jedes erfasste Bild muss über eine Datenverbindung – beispielsweise USB, Camera Link oder PCIe – zur Verarbeitung oder Speicherung an den Computer übertragen werden. Die benötigte Bandbreite hängt von folgenden Faktoren ab:

● Bildgröße (Anzahl der Pixel)

● Bittiefe (Daten pro Pixel)

● Bildrate

Die Datenrate kann wie folgt geschätzt werden:

Datenrate ≈ (Pixel pro Frame × Bittiefe × Bildrate)

Ein 2048 × 2048 Pixel großer Sensor, der mit 16-Bit-Farbtiefe und 100 Bildern pro Sekunde arbeitet, erzeugt beispielsweise über 800 MB/s Rohdaten. Kann die Schnittstelle diesen Datendurchsatz nicht bewältigen, wird die effektive Bildrate reduziert oder Bilder werden intern zwischengespeichert.

In vielen Systemen führt die Reduzierung des ROI oder der Wechsel zu einer geringeren Bittiefe nicht nur zu einer Verkürzung der Auslesezeit, sondern auch zu einer Verringerung der benötigten Bandbreite, wodurch die Schnittstelle eine höhere Bildrate (FPS) aufrechterhalten kann.

Es ist daher wichtig, zwischen Folgendem zu unterscheiden:

●Sensorbegrenzte Bildrate, bestimmt durch die Leitungszeit und die Auslesung

●Schnittstellenbegrenzte Bildrate, bestimmt durch Bandbreite und Systemkonfiguration

Speichergeschwindigkeit, Treibereffizienz und Software-Overhead können sich ebenfalls auf die Leistung in der Praxis auswirken, insbesondere bei anhaltender Hochgeschwindigkeits-Datenerfassung.

Um Einschränkungen der Bildrate zu diagnostizieren, ist es unerlässlich zu verstehen, wo der Flaschenhals liegt – bei der Sensor-Timing oder der Datenübertragung.

Warum Ihre tatsächliche Bildrate niedriger ist als die Spezifikation

Die in den technischen Daten einer Kamera angegebene maximale Bildrate wird üblicherweise unter Idealbedingungen berechnet – oft mit einem reduzierten Bildausschnitt (ROI), kurzer Belichtungszeit, einem bestimmten Auslesemodus und optimaler Schnittstellenkonfiguration. In der Praxis kann die erreichbare Bildrate aufgrund verschiedener Faktoren niedriger ausfallen.

1. Vollständiger Sensor vs. Reduzierter ROI

Viele maximale FPS-Werte werden anhand eines Teilbereichs des Bildausschnitts angegeben. Bei Betrieb der Kamera mit voller Sensorauflösung erhöht die höhere Zeilenanzahl direkt die Bildlesezeit und reduziert somit die erreichbare Bildrate.

2. Belichtungszeit überschreitet Auslesezeit

Ist die Belichtungszeit länger als die Auslesezeit des Sensors, wird sie zum limitierenden Faktor. Bei Aufnahmen in schwachem Licht verringern längere Integrationszeiten naturgemäß die maximale Bildrate (FPS), unabhängig von der Auslesefähigkeit des Sensors.

3. Höhere Farbtiefe oder HDR-Modi

Der Betrieb im 16-Bit- oder HDR-Modus erhöht das Datenvolumen und kann die Auslesezeiten verändern. Dies kann die erreichbare Bildrate im Vergleich zu „Speed“-Modi mit geringerer Bittiefe reduzieren.

4. Beschränkungen der Schnittstellenbandbreite

USB-, Camera-Link- oder PCIe-Schnittstellen verfügen über eine begrenzte Bandbreite. Übersteigt die erforderliche Datenrate den durchführbaren Datendurchsatz der Schnittstelle, kann die effektive Bildrate (FPS) reduziert oder intern gepuffert werden.

5. Software- und Verarbeitungsaufwand

Triggerkonfiguration, Pufferstrategie, Speichergeschwindigkeit und Verarbeitungslast können die kontinuierliche Bildrate bei realen Aufnahmen beeinflussen.

Um Abweichungen in der Bildrate zu diagnostizieren, ist es wichtig festzustellen, ob die Einschränkung auf das Sensor-Timing, die Belichtungsdauer oder den Datendurchsatz zurückzuführen ist. Erst nach der Identifizierung des Engpasses kann die Leistung effektiv optimiert werden.

So optimieren Sie die Bildrate für Ihre Anwendung

Die Optimierung der Bildrate beginnt mit der Identifizierung des tatsächlichen limitierenden Faktors Ihres Bildgebungssystems. Sobald der Flaschenhals erkannt ist, können gezielte Anpassungen die Aufnahmegeschwindigkeit deutlich verbessern.

1. Verkleinern Sie den Interessenbereich (ROI).

Wenn die volle Sensorauflösung nicht benötigt wird, ist die Reduzierung der aktiven Zeilenanzahl oft der effektivste Weg, die Bildrate zu erhöhen. Da die Auslesezeit eines Bildes mit der Zeilenanzahl skaliert, kann die Beschränkung der Bildaufnahme auf den relevanten Bereich die FPS deutlich steigern.

2. Belichtungszeit anpassen

Wenn die Belichtungszeit die Auslesezeit überschreitet, wird sie zum limitierenden Faktor. Durch Erhöhung der Beleuchtungsstärke, entsprechende Anpassung der Verstärkung oder Reduzierung der Signalanforderungen lassen sich kürzere Belichtungszeiten und höhere Bildraten erzielen.

3. Wählen Sie einen geeigneten Auslesemodus.

Wenn ein hoher Dynamikbereich nicht entscheidend ist, sollte, sofern verfügbar, ein geschwindigkeitsoptimierter Modus verwendet werden. Eine geringere Bittiefe oder alternative Verstärkungsmodi können den Aufwand für Auslesen und Datenübertragung reduzieren.

4. Schnittstellen- und Datendurchsatz prüfen

Stellen Sie sicher, dass die Schnittstellenbandbreite die erforderliche Datenrate unterstützt. Eine Reduzierung der Bittiefe, eine Begrenzung der Auflösung oder eine Verbesserung der Datenverbindung können die dauerhafte Leistung steigern.

5. Identifizieren Sie die dominante Nebenbedingung

Die Optimierung der Bildrate ist am effektivsten, wenn die Änderungen auf die tatsächliche limitierende Komponente – Sensorauslesung, Belichtungsdauer oder Schnittstellenbandbreite – abzielen, anstatt nicht damit zusammenhängende Parameter anzupassen.

Abschluss

Die Bildrate einer Kamera ist keine feste Größe, sondern das Ergebnis des Zusammenspiels von Sensortaktung, Belichtungsdauer und Datendurchsatz unter bestimmten Betriebsbedingungen. Das Verständnis des Zusammenhangs zwischen Zeilenzeit, Bildlesezeit, Belichtungszeit und Schnittstellenbandbreite ist entscheidend für die Bewertung und Optimierung der Aufnahmegeschwindigkeit. In der Praxis wird die erreichbare Bildrate durch das langsamste Glied in der Bildverarbeitungskette bestimmt.

At TucsenDie Bildwiederholrate wird unter Berücksichtigung realer Systembeschränkungen – einschließlich Auslesearchitektur, Modusauswahl und Schnittstellenkonfiguration – entwickelt und validiert. Benötigt Ihre Anwendung eine dauerhafte Hochgeschwindigkeitsaufnahme, unterstützt Sie unser Team gerne bei der Ermittlung der tatsächlichen Leistungsgrenzen innerhalb Ihres spezifischen Workflows.

Tucsen Photonics Co., Ltd. Alle Rechte vorbehalten. Bitte geben Sie bei Zitaten die Quelle an:www.tucsen.com

25.02.2022

25.02.2022