La frequenza dei fotogrammi di una telecamera indica quante immagini può acquisire al secondo ed è spesso considerata una specifica fondamentale nella valutazione dei sistemi di imaging ad alta velocità. Negli esperimenti dinamici, nei flussi di lavoro di ispezione o nei processi biologici rapidi, la frequenza dei fotogrammi determina direttamente la quantità di dettagli temporali che possono essere catturati.

Tuttavia, la frequenza dei fotogrammi massima specificata non è un valore fisso. Dipende dall'architettura del sensore, dalla regione di interesse (ROI), dal tempo di esposizione, dalla modalità di lettura e dalla larghezza di banda dell'interfaccia dati. In pratica, la frequenza dei fotogrammi raggiungibile è il risultato di molteplici fattori interagenti. Comprendere questi fattori richiede di guardare oltre i fotogrammi al secondo ed esaminare come viene strutturato il tempo di un fotogramma all'interno del sistema della telecamera.

Cos'è la frequenza dei fotogrammi di una fotocamera?

La frequenza dei fotogrammi di una telecamera si riferisce al numero di fotogrammi che una telecamera può acquisire al secondo in determinate condizioni operative. Viene tipicamente espressa in fotogrammi al secondo (FPS) e rappresenta la velocità con cui le immagini successive possono essere catturate e rese disponibili per l'elaborazione o l'archiviazione.

La frequenza dei fotogrammi determina la risoluzione temporale di un sistema di imaging. Nelle applicazioni dinamiche, come il tracciamento di particelle, l'ispezione ad alta velocità o i processi biologici in rapida evoluzione, frequenze di fotogrammi più elevate consentono un'osservazione più dettagliata del movimento e degli eventi transitori.

Tuttavia, la frequenza dei fotogrammi non è una specifica isolata. Il numero massimo di fotogrammi al secondo (FPS) raggiungibile dipende dalla modalità della fotocamera, dalla regione di interesse (ROI), dal tempo di esposizione, dalla profondità di bit e dalla larghezza di banda dell'interfaccia. Una "frequenza dei fotogrammi massima" dichiarata di solito presuppone condizioni specifiche, come una ROI ridotta o una particolare modalità di lettura.

Per comprendere cosa limiti realmente la frequenza dei fotogrammi, è necessario esaminare il tempo necessario per acquisire e leggere un singolo fotogramma, noto come tempo di frame, argomento che verrà approfondito nella sezione successiva.

Frequenza dei fotogrammi vs Tempo di fotogramma vs Tempo di riga

La frequenza dei fotogrammi viene comunemente espressa in fotogrammi al secondo (FPS), ma l'FPS non è un parametro fisico primario. È l'inverso del tempo necessario per acquisire e leggere un singolo fotogramma.

Frequenza dei fotogrammi = 1 / Tempo del fotogramma

Per comprendere cosa determina la frequenza dei fotogrammi, dobbiamo quindi esaminare come viene strutturato il tempo di un fotogramma.

Da cosa è composto il tempo di visualizzazione di un fotogramma?

Il tempo di frame rappresenta il tempo totale necessario per produrre un'immagine completa. Nella maggior parte dei casiTelecamere CMOSCiò include:

● Tempo di esposizione (per quanto tempo il sensore raccoglie la luce)

● Tempo di lettura del sensore (quanto tempo ci vuole per convertire e trasferire i valori dei pixel)

● Tempo di trasferimento dati (trasmissione dell'interfaccia al computer host)

Quando il tempo di esposizione è breve rispetto al tempo di lettura, la frequenza dei fotogrammi è in genere limitata dal processo di lettura. Quando il tempo di esposizione è lungo, invece, può diventare il fattore limitante dominante.

Tempo di linea: il vincolo fondamentale del sensore

Nei sensori CMOS, il principale fattore interno che limita la frequenza dei fotogrammi è il tempo di riga. Il tempo di riga è il tempo necessario a una fila di convertitori analogico-digitali (ADC) per misurare e digitalizzare una riga di pixel.

Nella maggior parte delle architetture, ogni riga viene elaborata in sequenza. Di conseguenza, il tempo totale di lettura per un frame è determinato dal numero di righe attive moltiplicato per il tempo di linea:

Tempo di lettura del frame = Tempo di riga × Numero di righe

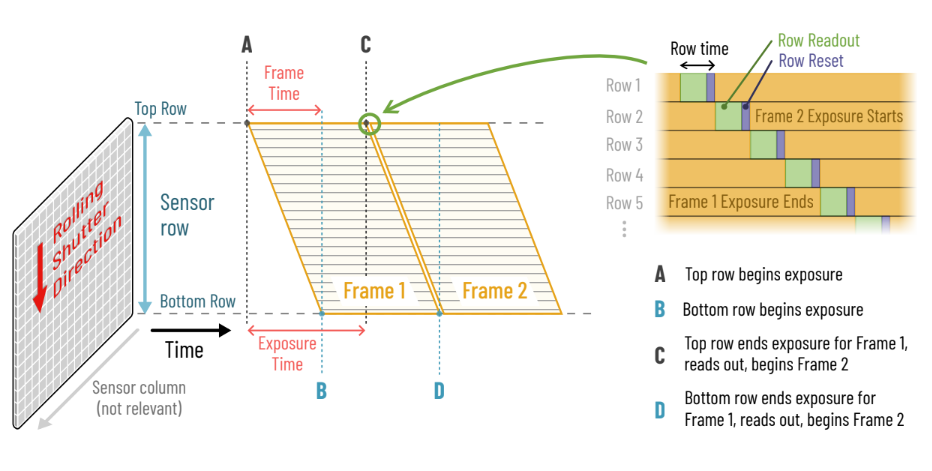

Figura 1: Introduzione ai diagrammi di temporizzazione dell'otturatore a scorrimento "parallelogramma".

Sinistra:Grafico della riga del sensore (asse y) in funzione del tempo (asse x), con parallelogrammi gialli che indicano l'esposizione di ciascuna riga della fotocamera dovuta all'azione dell'otturatore a scorrimento.

Giusto:Un ingrandimento a livello di singola riga, che illustra il ruolo svolto dalla lettura e dal ripristino nella determinazione del tempo di riga dell'otturatore a scorrimento.

Questo spiega perché ridurre la regione di interesse (ROI), nello specifico il numero di righe di pixel, può aumentare significativamente il frame rate. Dimezzare il numero di righe dimezza approssimativamente il tempo di lettura e può quasi raddoppiare gli FPS raggiungibili, supponendo che gli altri fattori rimangano costanti.

Il tempo di riga può variare tra le diverse modalità di lettura, ma all'interno di una data modalità è in genere fisso.

Frequenza dei fotogrammi teorica vs. frequenza dei fotogrammi reale

La "frequenza massima dei fotogrammi" indicata nelle specifiche viene solitamente calcolata solo in base al tempo di lettura del fotogramma. In pratica, la frequenza dei fotogrammi reale potrebbe essere inferiore a causa di:

● Tempi di esposizione più lunghi

● Tempi di esposizione più lunghi

● Limitazioni della larghezza di banda dell'interfaccia

● Ritardi del software o dell'elaborazione

Per questo motivo, è importante distinguere tra il frame rate massimo teorico e il frame rate effettivamente raggiungibile nelle proprie condizioni operative.

Fattori a livello del sensore che influenzano la frequenza dei fotogrammi

Sebbene il tempo di riga e il tempo di lettura del fotogramma definiscano i limiti temporali fondamentali di un sensore, diversi parametri configurabili a livello di telecamera possono influenzare significativamente la frequenza dei fotogrammi raggiungibile.

Regione di interesse (ROI)

Il numero di righe di pixel attive determina direttamente il tempo di lettura del frame. Riducendo l'altezza della regione di interesse, diminuisce il numero di righe da leggere, accorciando così la durata della lettura.

Poiché il tempo di lettura dei fotogrammi è approssimativamente proporzionale al numero di righe, dimezzare l'altezza della ROI può quasi raddoppiare la frequenza dei fotogrammi massima raggiungibile, a condizione che il tempo di esposizione e la larghezza di banda dell'interfaccia non siano fattori limitanti. Per le applicazioni incentrate su una piccola area di movimento o rilevamento, la ROI è spesso il metodo più efficace per aumentare la velocità.

Raggruppamento e sottocampionamento

Il pixel binning combina i pixel adiacenti prima della lettura o della digitalizzazione, riducendo efficacemente la risoluzione di output e il volume totale dei dati. A seconda dell'architettura del sensore, il binning può ridurre i requisiti di throughput dei dati e talvolta migliorare la frequenza di fotogrammi effettiva.

Tuttavia, il binning non sempre riduce il tempo di lettura interno. In molti progetti CMOS, le righe vengono ancora lette in sequenza anche quando i pixel vengono combinati. Di conseguenza, il binning può migliorare l'efficienza del trasferimento dati senza alterare in modo significativo i tempi di lettura intrinseci.

Profondità di bit e modalità di lettura

Moltitelecamere scientificheOffrono diverse modalità di lettura, spesso privilegiando la velocità a scapito della gamma dinamica. Ad esempio, una modalità a 16 bit ad alta gamma dinamica può dare priorità al basso rumore di lettura e all'elevata capacità di saturazione, mentre una "modalità velocità" a 12 bit può raggiungere frame rate più elevati riducendo la precisione dei dati o modificando le impostazioni di amplificazione.

Poiché una maggiore profondità di bit aumenta la quantità di dati per fotogramma, il passaggio a una profondità di bit inferiore può ridurre il carico di trasferimento dati e, in alcuni casi, consentire frame rate più elevati, soprattutto quando la larghezza di banda dell'interfaccia è un fattore limitante.

Interazione tra tempo di esposizione e frequenza dei fotogrammi

La frequenza dei fotogrammi non è determinata unicamente dal tempo di lettura del sensore. Anche la durata dell'esposizione può limitare la velocità con cui è possibile acquisire fotogrammi successivi.

In generale, la frequenza di fotogrammi massima raggiungibile è determinata dal componente temporale più lungo: il tempo di esposizione o il tempo di lettura del fotogramma. Se il tempo di esposizione è inferiore al tempo di lettura, quest'ultimo limita la frequenza di fotogrammi. Tuttavia, se il tempo di esposizione supera la durata della lettura, il tempo di esposizione diventa il fattore limitante dominante.

In molti sensori CMOS a rolling shutter, l'esposizione e la lettura possono sovrapporsi parzialmente. Mentre una riga viene letta, altre righe possono già integrare la luce per il fotogramma successivo. Questa sovrapposizione consente di ridurre il tempo di esposizione rispetto al tempo di lettura completo del fotogramma, senza necessariamente diminuire la frequenza dei fotogrammi.

Tuttavia, quando il tempo di esposizione supera il tempo totale di lettura del sensore, come ad esempio nelle riprese in condizioni di scarsa illuminazione che richiedono tempi di integrazione più lunghi, la frequenza dei fotogrammi diminuisce proporzionalmente. In questi casi:

Frequenza massima dei fotogrammi ≈ 1 / Tempo di esposizione

Comprendere se il sistema è limitato dalla velocità di lettura o dall'esposizione è fondamentale per ottimizzare la velocità di acquisizione. Aumentare il guadagno, migliorare l'illuminazione o ridurre il tempo di integrazione richiesto può essere più efficace per incrementare la frequenza dei fotogrammi rispetto alla sola regolazione del ROI o della modalità di lettura.

Limitazioni di larghezza di banda dell'interfaccia e di velocità di trasmissione dei dati

Anche se un sensore è in grado di acquisire fotogrammi ad alta velocità, l'interfaccia tra la telecamera e il computer host può diventare il fattore limitante.

Ogni fotogramma acquisito deve essere trasferito tramite un collegamento dati, come USB, Camera Link o PCIe, al computer per l'elaborazione o l'archiviazione. La larghezza di banda necessaria dipende da:

● Dimensione del fotogramma (numero di pixel)

● Profondità di bit (dati per pixel)

● Frequenza dei fotogrammi

La velocità di trasmissione dei dati può essere stimata come segue:

Velocità di trasmissione dati ≈ (Pixel per fotogramma × Profondità di bit × Frequenza dei fotogrammi)

Ad esempio, un sensore da 2048 × 2048 pixel che opera a 16 bit di profondità e 100 FPS genera oltre 800 MB/s di dati grezzi. Se l'interfaccia non è in grado di supportare questa velocità di trasmissione, la frequenza dei fotogrammi effettiva verrà ridotta oppure i fotogrammi potrebbero essere temporaneamente memorizzati in un buffer all'interno della telecamera.

In molti sistemi, la riduzione del ROI o il passaggio a una profondità di bit inferiore non solo diminuisce il tempo di lettura, ma riduce anche la larghezza di banda necessaria, consentendo all'interfaccia di mantenere un FPS più elevato.

È pertanto importante distinguere tra:

●Frequenza dei fotogrammi limitata dal sensore, determinato dal tempo di linea e dalla lettura

●frequenza dei fotogrammi limitata dall'interfaccia, determinato dalla larghezza di banda e dalla configurazione del sistema

La velocità di archiviazione, l'efficienza del driver e l'overhead del software possono influenzare le prestazioni nel mondo reale, soprattutto durante acquisizioni ad alta velocità prolungate.

Comprendere dove risiede il collo di bottiglia, che si tratti di tempistiche del sensore o di trasferimento dati, è essenziale per diagnosticare le limitazioni del frame rate.

Perché la tua frequenza di fotogrammi effettiva è inferiore a quella specificata

La frequenza di fotogrammi massima indicata nella scheda tecnica di una fotocamera viene in genere calcolata in condizioni ideali, spesso utilizzando un'area di interesse (ROI) ridotta, tempi di esposizione brevi, una specifica modalità di lettura e una configurazione ottimale dell'interfaccia. In pratica, la frequenza di fotogrammi effettivamente raggiungibile può essere inferiore a causa di diversi fattori comuni.

1. Sensore completo vs ROI ridotto

Molti valori massimi di FPS vengono indicati utilizzando una ROI parziale. Se si utilizza la telecamera alla massima risoluzione del sensore, l'aumento del numero di righe incrementa direttamente il tempo di lettura dei fotogrammi, riducendo la frequenza dei fotogrammi raggiungibile.

2. Il tempo di esposizione supera il tempo di lettura.

Se il tempo di esposizione è superiore al tempo di lettura del sensore, diventa il fattore limitante. Nelle riprese in condizioni di scarsa illuminazione, tempi di integrazione più lunghi riducono naturalmente il numero massimo di fotogrammi al secondo (FPS), indipendentemente dalla capacità di lettura del sensore.

3. Modalità con maggiore profondità di colore o HDR

L'utilizzo di modalità a 16 bit o ad alta gamma dinamica (HDR) aumenta il volume dei dati e può alterare i tempi di lettura. Ciò può ridurre la frequenza dei fotogrammi raggiungibile rispetto alle modalità "veloci" a profondità di bit inferiore.

4. Limitazioni della larghezza di banda dell'interfaccia

Le interfacce USB, Camera Link o PCIe hanno una larghezza di banda limitata. Se la velocità di trasmissione dati richiesta supera la velocità di trasmissione sostenuta dell'interfaccia, il numero di fotogrammi al secondo effettivi potrebbe essere ridotto o memorizzato in un buffer interno.

5. Costi generali del software e dell'elaborazione

La configurazione del trigger, la strategia di buffering, la velocità di archiviazione e il carico di elaborazione possono influire sulla frequenza dei fotogrammi sostenuta durante l'acquisizione in condizioni reali.

Per diagnosticare le discrepanze nel frame rate, è importante stabilire se la limitazione derivi dalla temporizzazione del sensore, dalla durata dell'esposizione o dalla velocità di trasmissione dei dati. Solo dopo aver identificato il collo di bottiglia è possibile ottimizzare efficacemente le prestazioni.

Come ottimizzare il frame rate per la tua applicazione

L'ottimizzazione del frame rate inizia con l'identificazione del vero fattore limitante nel sistema di imaging. Una volta compreso il collo di bottiglia, regolazioni mirate possono migliorare significativamente la velocità di acquisizione.

1. Ridurre la regione di interesse (ROI)

Se non è necessaria la massima risoluzione del sensore, ridurre il numero di righe attive è spesso il modo più efficace per aumentare il frame rate. Poiché il tempo di lettura del frame è proporzionale al numero di righe, limitare l'acquisizione all'area di interesse può incrementare significativamente gli FPS.

2. Regolare il tempo di esposizione

Quando il tempo di esposizione supera il tempo di lettura, diventa il fattore limitante. Aumentando l'intensità dell'illuminazione, regolando opportunamente il guadagno o allentando i requisiti del segnale è possibile ottenere tempi di esposizione più brevi e frequenze di fotogrammi più elevate.

3. Selezionare una modalità di lettura appropriata

Se disponibile, utilizzare una modalità ottimizzata per la velocità quando un'elevata gamma dinamica non è fondamentale. Una minore profondità di bit o modalità di amplificazione alternative possono ridurre il carico di lettura e di trasferimento dei dati.

4. Verificare l'interfaccia e la velocità di trasmissione dei dati.

Assicurarsi che la larghezza di banda dell'interfaccia supporti la velocità di trasmissione dati richiesta. Ridurre la profondità di bit, limitare la risoluzione o aggiornare il collegamento dati potrebbe migliorare le prestazioni a lungo termine.

5. Identificare il vincolo dominante

L'ottimizzazione del frame rate è più efficace quando le modifiche riguardano il vero componente limitante, ovvero la velocità di lettura del sensore, la durata dell'esposizione o la larghezza di banda dell'interfaccia, piuttosto che la regolazione di parametri non correlati.

Conclusione

La frequenza dei fotogrammi di una telecamera non è una specifica fissa, ma il risultato dell'interazione tra temporizzazione del sensore, durata dell'esposizione e velocità di trasmissione dei dati in specifiche condizioni operative. Comprendere la relazione tra tempo di riga, tempo di lettura del fotogramma, tempo di esposizione e larghezza di banda dell'interfaccia è fondamentale per valutare o ottimizzare la velocità di acquisizione. In pratica, la frequenza dei fotogrammi raggiungibile è determinata dal componente più lento della catena di elaborazione delle immagini.

At TucsenLe prestazioni del frame rate vengono progettate e validate tenendo conto dei vincoli reali del sistema, tra cui l'architettura di lettura, la selezione della modalità e la configurazione dell'interfaccia. Se la tua applicazione richiede un'acquisizione ad alta velocità continua, il nostro team può aiutarti a valutare i limiti prestazionali effettivi all'interno del tuo specifico flusso di lavoro.

Tucsen Photonics Co., Ltd. Tutti i diritti riservati. In caso di citazione, si prega di indicare la fonte:www.tucsen.com

25/02/2022

25/02/2022