Kamerans bildfrekvens beskriver hur många bilder en kamera kan fånga per sekund, och den behandlas ofta som en huvudspecifikation vid utvärdering av höghastighetsavbildningssystem. I dynamiska experiment, inspektionsarbetsflöden eller snabba biologiska processer avgör bildfrekvensen direkt hur mycket tidsmässig detalj som kan fångas.

Den angivna maximala bildfrekvensen är dock inte ett fast värde. Den beror på sensorarkitektur, intresseområde (ROI), exponeringstid, avläsningsläge och datagränssnittets bandbredd. I praktiken är den uppnåeliga bildfrekvensen resultatet av flera samverkande faktorer. För att förstå dessa faktorer krävs det att man tittar bortom bildrutor per sekund och undersöker hur bildtiden är konstruerad inuti kamerasystemet.

Vad är kamerans bildfrekvens?

Kamerans bildfrekvens avser antalet bildrutor en kamera kan fånga per sekund under en definierad uppsättning driftsförhållanden. Den uttrycks vanligtvis i bildrutor per sekund (FPS) och representerar hur snabbt efterföljande bilder kan tas och göras tillgängliga för bearbetning eller lagring.

Bildfrekvensen avgör den tidsmässiga upplösningen för ett avbildningssystem. I dynamiska tillämpningar – såsom partikelspårning, höghastighetsinspektion eller snabbt föränderliga biologiska processer – möjliggör högre bildfrekvenser mer detaljerad observation av rörelse och övergående händelser.

Bildfrekvens är dock inte en isolerad specifikation. Den maximala uppnåeliga FPS beror på kameraläge, intresseområde (ROI), exponeringstid, bitdjup och gränssnittsbandbredd. En angiven "maximal bildfrekvens" förutsätter vanligtvis specifika villkor, såsom reducerad ROI eller ett visst avläsningsläge.

För att förstå vad som verkligen begränsar bildhastigheten krävs det att undersöka hur lång tid det tar att hämta och läsa ut en enda bildruta – känd som bildtid – vilket utforskas i nästa avsnitt.

Bildfrekvens kontra bildtid kontra linjetid

Bildfrekvens uttrycks vanligtvis i bildrutor per sekund (FPS), men FPS är inte en primär fysisk parameter. Det är inversen av den tid som krävs för att hämta och läsa ut en enda bildruta.

Bildfrekvens = 1 / Bildtid

För att förstå vad som avgör bildhastigheten måste vi därför undersöka hur bildtid konstrueras.

Vad utgör bildtid?

Bildtid representerar den totala tid som krävs för att producera en komplett bild. I de flesta fallCMOS-kameror, detta inkluderar:

● Exponeringstid (hur länge sensorn samlar in ljus)

● Sensoravläsningstid (hur lång tid det tar att konvertera och överföra pixelvärden)

● Dataöverföringstid (gränssnittsöverföring till värddatorn)

När exponeringstiden är kort i förhållande till avläsningstiden begränsas bildfrekvensen vanligtvis av avläsningsprocessen. När exponeringstiden är lång kan den istället bli den dominerande begränsande faktorn.

Linjetid — Den grundläggande sensorbegränsningen

För CMOS-sensorer är den primära interna faktorn som begränsar bildhastigheten linjetiden. Linjetiden är den tid som krävs för en rad analog-till-digital-omvandlare (ADC) att mäta och digitalisera en rad pixlar.

I de flesta arkitekturer bearbetas varje rad sekventiellt. Som ett resultat bestäms den totala utläsningstiden för en ram av antalet aktiva rader multiplicerat med radtiden:

Lästid för bildruta = Radtid × Antal rader

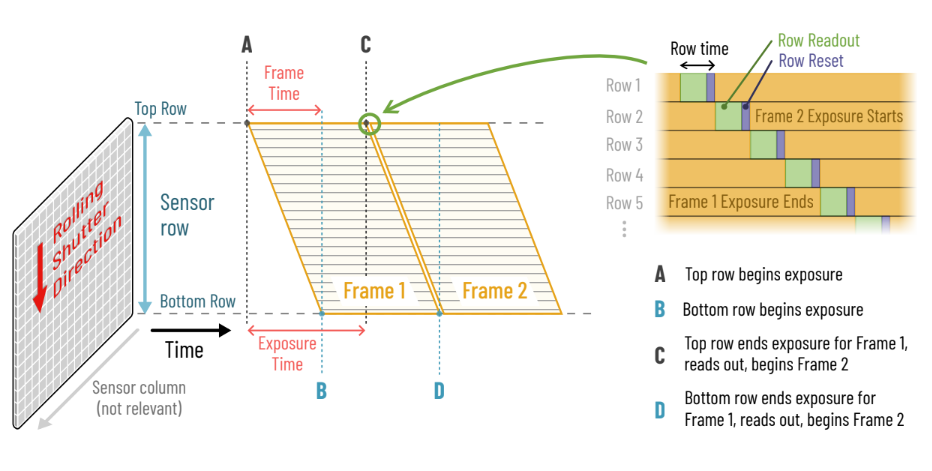

Figur 1: Introduktion till tidsdiagram för rullande jalusier i 'parallellogram'

Vänster:Diagram över sensorrad (y-axeln) kontra tid (x-axeln), med gula parallellogram som markerar exponeringen för varje kamerarad på grund av den rullande slutarens verkan.

Rätt:En inzoomning till den individuella radnivån, som illustrerar rollavläsningen och återställningsspelet vid bestämning av rullande jalusilinjetid.

Detta förklarar varför en minskning av intresseområdet (ROI) – specifikt antalet pixelrader – kan öka bildfrekvensen avsevärt. Att halvera antalet rader ungefär halverar avläsningstiden och kan nästan fördubbla den uppnåeliga FPS, förutsatt att andra faktorer förblir konstanta.

Linjetiden i sig kan variera mellan avläsningslägen, men inom ett givet läge är den vanligtvis fast.

Teoretisk vs. verklig bildfrekvens

Den "maximala bildfrekvensen" som anges i specifikationerna beräknas vanligtvis enbart utifrån bildläsningstiden. I praktiken kan den verkliga bildfrekvensen vara lägre på grund av:

● Längre exponeringstider

● Längre exponeringstider

● Begränsningar för gränssnittsbandbredd

● Förseningar i programvara eller bearbetning

Av denna anledning är det viktigt att skilja mellan teoretisk maximal FPS och den uppnåeliga bildfrekvensen under dina faktiska driftsförhållanden.

Sensornivåfaktorer som påverkar bildfrekvensen

Medan linjetid och bildläsningstid definierar de grundläggande tidsgränserna för en sensor, kan flera konfigurerbara parametrar på kameranivå avsevärt påverka den uppnåeliga bildhastigheten.

Intresseområde (ROI)

Antalet aktiva pixelrader avgör direkt bildläsningstiden. Att minska höjden på det intressanta området minskar antalet rader som måste läsas, vilket förkortar avläsningstiden.

Eftersom bildläsningstiden skalas ungefär med antalet rader kan en halvering av ROI-höjden nästan fördubbla den maximalt uppnåeliga bildfrekvensen – förutsatt att exponeringstid och gränssnittsbandbredd inte är begränsande faktorer. För applikationer som fokuserar på ett litet rörelse- eller detekteringsområde är ROI ofta det mest effektiva sättet att öka hastigheten.

Binning och subsampling

Pixelbinning kombinerar intilliggande pixlar före avläsning eller digitalisering, vilket effektivt minskar utdataupplösningen och den totala datavolymen. Beroende på sensorarkitekturen kan binning minska dataflödeskraven och ibland förbättra den effektiva bildfrekvensen.

Binning minskar dock inte alltid den interna linjetiden. I många CMOS-konstruktioner läses rader fortfarande sekventiellt även när pixlar kombineras. Som ett resultat kan binning förbättra dataöverföringseffektiviteten utan att den intrinsiska avläsningstidpunkten avsevärt förändras.

Bitdjup och avläsningslägen

Mångavetenskapliga kamerorerbjuder flera avläsningslägen, ofta med byte av dynamiskt omfång mot hastighet. Till exempel kan ett 16-bitars läge med högt dynamiskt omfång prioritera lågt läsbrus och stor fullbrunnskapacitet, medan ett 12-bitars "hastighetsläge" kan uppnå högre bildhastigheter genom att minska dataprecisionen eller ändra förstärkningsinställningarna.

Eftersom högre bitdjup ökar mängden data per bildruta kan en övergång till ett lägre bitdjup minska dataöverföringsbelastningen och i vissa fall möjliggöra högre bildhastigheter – särskilt när gränssnittsbandbredd är en begränsande faktor.

Interaktion mellan exponeringstid och bildfrekvens

Bildfrekvensen bestäms inte enbart av sensorns avläsningstid. Exponeringstiden kan också begränsa hur snabbt efterföljande bildrutor kan tas.

I allmänhet styrs den maximalt uppnåeliga bildfrekvensen av den tidskomponent som är längre: exponeringstiden eller bildläsningstiden. Om exponeringstiden är kortare än avläsningstiden begränsar avläsningen bildfrekvensen. Om exponeringstiden däremot överstiger avläsningstiden blir exponeringen den dominerande begränsningen.

I många CMOS-konstruktioner med rullande slutare kan exponering och avläsning delvis överlappa varandra. Medan en rad läses ut kan andra rader redan integrera ljus för nästa bildruta. Denna överlappning gör att exponeringstiden kan vara kortare än hela bildrutans lästid utan att nödvändigtvis minska bildfrekvensen.

Men när exponeringstiden blir längre än sensorns totala avläsningstid – till exempel vid fotografering i svagt ljus som kräver längre integration – minskar bildfrekvensen proportionellt. I sådana fall:

Maximal bildfrekvens ≈ 1 / Exponeringstid

Att förstå om ditt system är avläsningsbegränsat eller exponeringsbegränsat är avgörande när man optimerar förvärvshastigheten. Att öka förstärkningen, förbättra belysningen eller minska den nödvändiga integrationstiden kan vara mer effektivt för att höja bildfrekvensen än att enbart justera ROI eller avläsningsläge.

Begränsningar för gränssnittsbandbredd och dataflöde

Även om en sensor kan läsa av bildrutor med hög hastighet kan gränssnittet mellan kameran och värddatorn bli den begränsande faktorn.

Varje insamlad bildruta måste överföras via en datalänk – till exempel USB, Camera Link eller PCIe – till datorn för bearbetning eller lagring. Den erforderliga bandbredden beror på:

● Bildstorlek (antal pixlar)

● Bitdjup (data per pixel)

● Bildfrekvens

Datahastigheten kan uppskattas som:

Datahastighet ≈ (Pixlar per bildruta × Bitdjup × Bildrutehastighet)

Till exempel genererar en 2048 × 2048-sensor som arbetar med 16-bitars djup och 100 FPS över 800 MB/s rådata. Om gränssnittet inte kan hantera denna dataflödeshastighet kommer den effektiva bildhastigheten att minskas, eller så kan bildrutor buffras tillfälligt inuti kameran.

I många system minskar inte bara avläsningstiden utan minskar även den erforderliga bandbredden om man minskar ROI eller byter till ett lägre bitdjup, vilket gör att gränssnittet kan upprätthålla högre FPS.

Det är därför viktigt att skilja mellan:

●Sensorbegränsad bildfrekvens, bestämd av linjetid och avläsning

●Gränssnittsbegränsad bildhastighet, bestämd av bandbredd och systemkonfiguration

Lagringshastighet, drivrutinseffektivitet och programvarukostnader kan också påverka verklig prestanda, särskilt vid långvarig höghastighetsinsamling.

Att förstå var flaskhalsen ligger – sensortiming eller dataöverföring – är avgörande när man diagnostiserar begränsningar i bildhastigheten.

Varför din verkliga bildfrekvens är lägre än specifikationen

Den maximala bildfrekvensen som anges i en kameras specifikationsblad beräknas vanligtvis under ideala förhållanden – ofta med hjälp av ett reducerat intresseområde (ROI), kort exponeringstid, specifikt avläsningsläge och optimal gränssnittskonfiguration. I praktiken kan den uppnåeliga bildfrekvensen vara lägre på grund av flera gemensamma faktorer.

1. Full sensor kontra minskad ROI

Många maximala FPS-värden anges med hjälp av en partiell ROI. Om du använder kameran med full sensorupplösning ökar det ökade antalet rader direkt bildläsningstiden, vilket minskar den uppnåeliga bildfrekvensen.

2. Exponeringstiden överstiger avläsningstiden

Om exponeringstiden är längre än sensorns bildläsningstid blir den den begränsande faktorn. Vid fotografering i svagt ljus minskar längre integrationstider naturligtvis maximal bildfrekvens, oavsett sensorns avläsningsförmåga.

3. Högre bitdjup eller HDR-lägen

Att använda 16-bitars eller HDR-lägen (High Dynamic Range) ökar datavolymen och kan förändra avläsningstidpunkten. Detta kan minska den uppnåeliga bildhastigheten jämfört med lägen med lägre bitdjup (“speed”).

4. Begränsningar för gränssnittsbandbreddsnivå

USB-, Camera Link- eller PCIe-gränssnitt har begränsad bandbredd. Om den erforderliga datahastigheten överstiger den bibehållna gränssnittsgenomströmningen kan effektiv FPS minskas eller buffras internt.

5. Programvara och bearbetningskostnader

Triggerkonfiguration, buffringsstrategi, lagringshastighet och bearbetningsbelastning kan alla påverka den bibehållna bildhastigheten under verklig förvärvning.

För att diagnostisera skillnader i bildfrekvens är det viktigt att identifiera om begränsningen härrör från sensorns timing, exponeringstid eller dataflöde. Först efter att ha identifierat flaskhalsen kan prestandan optimeras effektivt.

Hur man optimerar bildfrekvensen för din applikation

Optimering av bildfrekvensen börjar med att identifiera den verkliga begränsande faktorn i ditt bildsystem. När flaskhalsen väl är förstådd kan riktade justeringar avsevärt förbättra bildtagningshastigheten.

1. Minska intresseområdet (ROI)

Om full sensorupplösning inte krävs är det ofta det mest effektiva sättet att öka bildfrekvensen att minska antalet aktiva rader. Eftersom bildläsningstiden skalas med radantalet kan begränsning av läsning till det aktuella området öka FPS avsevärt.

2. Justera exponeringstiden

När exponeringstiden överstiger avläsningstiden blir den en begränsande faktor. Att öka ljusintensiteten, justera förstärkningen på lämpligt sätt eller att lätta på signalkraven kan möjliggöra kortare exponeringstider och högre bildfrekvenser.

3. Välj ett lämpligt avläsningsläge

Om möjligt, använd ett hastighetsoptimerat läge när högt dynamiskt omfång inte är kritiskt. Lägre bitdjup eller alternativa förstärkningslägen kan minska avläsnings- och dataöverföringsbördan.

4. Kontrollera gränssnitt och dataflöde

Säkerställ att gränssnittsbandbredden stöder den erforderliga datahastigheten. Att minska bitdjupet, begränsa upplösningen eller uppgradera datalänken kan förbättra den varaktiga prestandan.

5. Identifiera den dominerande begränsningen

Bildfrekvensoptimering är mest effektiv när ändringar riktar sig mot den verkliga begränsande komponenten – sensoravläsning, exponeringstid eller gränssnittsbandbredd – snarare än att justera orelaterade parametrar.

Slutsats

Kamerans bildhastighet är inte en fast specifikation, utan resultatet av sensorns timing, exponeringstid och dataflöde som samverkar under specifika driftsförhållanden. Att förstå förhållandet mellan linjetid, bildläsningstid, exponeringstid och gränssnittsbandbredd är avgörande när man utvärderar eller optimerar inspelningshastighet. I praktiken bestäms den uppnåeliga bildhastigheten av den långsammaste komponenten i bildkedjan.

At Tucsen, bildhastighetsprestandan konstrueras och valideras inom verkliga systembegränsningar – inklusive avläsningsarkitektur, lägesval och gränssnittskonfiguration. Om din applikation kräver kontinuerlig höghastighetsinsamling kan vårt team hjälpa till att utvärdera de verkliga prestandagränserna inom ditt specifika arbetsflöde.

Tucsen Photonics Co., Ltd. Med ensamrätt. Vänligen ange källan vid citering:www.tucsen.com

2022/02/25

2022/02/25