En el campo de la imagen científica, ya sea en microscopía, astronomía o inspección de semiconductores, la resolución es un concepto fundamental que influye directamente en la calidad y utilidad de los datos capturados. En pocas palabras, la resolución determina la capacidad de un sistema de imagen para distinguir detalles finos en un objeto.

La alta resolución permite a los investigadores observar estructuras sutiles, detectar defectos menores o capturar mediciones precisas, mientras que la baja resolución puede ocultar información crucial. Comprender la resolución requiere más que simplemente contar píxeles. Factores como la óptica, la iluminación y el rendimiento del sensor contribuyen a la resolución efectiva de un sistema.

¿Qué es la resolución en la imagen científica?

En la fotografía de consumo, las pantallas de ordenadores y teléfonos inteligentes, y la transmisión de vídeo, el término «resolución» suele referirse al número de píxeles. Términos como «720p», «1080p» y «4K» definen la resolución por el número de filas horizontales de píxeles, mientras que describir la cámara de un teléfono inteligente como «20 MP» implica que tiene 20 millones de píxeles.

En la imagen científica, sin embargo, el término "resolución" significa algo diferente y específico. Es decir, la capacidad de "resolver" ópticamente los detalles espaciales finos en la imagen entre sí. Esto depende tanto de la configuración óptica como del tamaño de píxel de la cámara utilizada. Según esta definición, escampo de visión– no la resolución – que viene definida por el número de píxeles del sensor de nuestra cámara.

En cierto modo, toda la información lumínica captada por una cámara se ve afectada por la difracción y las aberraciones. Ya sea por una óptica imperfecta o por las limitaciones físicas derivadas de la longitud de onda de la luz, existe un límite en la captura de detalles que impide alcanzar la imagen perfecta. La resolución óptica es el nivel mínimo de detalle que se conserva.

Además, los píxeles de nuestra cámara no son infinitamente pequeños: por encima de cierta longitud de onda, las imágenes se pixelan. Este factor adicional, la resolución de la cámara, interactúa con la resolución óptica para definir la resolución general de nuestro sistema.

Definición de la resolución óptica: resolución limitada por difracción.

Si tuviéramos una lente perfecta, sin defectos, aberraciones ni fallos de diseño, ¿seríamos capaces de distinguir cualquier detalle, por pequeño que sea? En realidad, independientemente de la calidad de nuestra lente, las leyes físicas de las ondas de luz imponen un límite superior al poder de resolución de las lentes y los objetivos de microscopio.

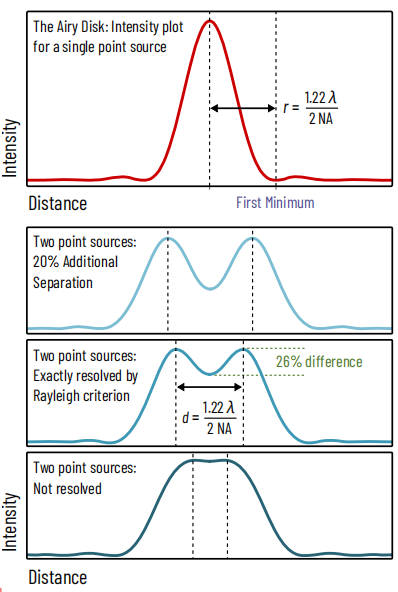

La difracción de la luz provoca desenfoque en una escala que depende de la longitud de onda de la luz utilizada y del tamaño de la apertura de las lentes empleadas para la iluminación y la formación de imágenes. Si una lente iluminara una fuente de luz puntual infinitamente pequeña pero brillante, la imagen resultante se desenfocaría adquiriendo una forma característica llamada disco de Airy, como se muestra en la Figura 1.

Figura 1: Definición de resolución: el criterio de Rayleigh

Un haz de luz puntual se dispersa mediante componentes ópticos para formar una imagen conocida como "disco de Airy". En microscopía, el tamaño de este disco está determinado por la longitud de onda de la luz y la apertura numérica del objetivo (en el modo de luz reflejada, por ejemplo, fluorescencia).

El criterio de Rayleigh para determinar si dos fuentes puntuales están resueltas se cumple si la distancia entre ellas es al menos igual a la distancia al primer mínimo del disco de Airy, y la relación de contraste entre los picos y el valle central es de al menos el 26%.

El criterio de Rayleigh

La definición de resolución limitada por difracción es, por lo tanto, "¿a qué distancia pueden acercarse dos fuentes de luz puntuales antes de que ya no puedan distinguirse (resolverse) como dos puntos separados?". Esto se muestra en la Figura 1.

Existen diversas convenciones matemáticas para determinar la ubicación exacta de esta línea, pero la más utilizada es el criterio de Rayleigh, según el cual el pico de un punto coincide con el primer mínimo del patrón de difracción del otro punto. Esto corresponde a una relación de contraste del 26 % entre la intensidad de los picos y el valle entre ellos.

En términos espaciales, la escala de longitud mínima resoluble puede definirse como una distancia mínima entre puntos, o en términos angulares como un ángulo mínimo con respecto al eje óptico de una lente.

La función de dispersión de puntos (PSF)

La forma real de un patrón de difracción para una fuente de luz puntual una vez que es capturada por un sistema óptico se llamafunción de dispersión de puntos(PSF). En microscopía avanzada, a menudo se mide en tres dimensiones. La forma de la PSF puede verse afectada por cada elemento óptico en la trayectoria de la luz, y minimizar su tamaño para maximizar el poder de resolución es un objetivo común para los ingenieros ópticos.

Algunas técnicas de análisis, como la deconvolución, suelen requerir como entrada la forma tridimensional de la PSF. Además, la forma de la PSF se puede modificar deliberadamente para codificar información adicional, como la posición vertical (eje z) del punto, en un campo conocido como ingeniería de PSF.

Definición de la resolución óptica: limitaciones de la calidad de las lentes: MTF y CTF

En la práctica, para muchos sistemas ópticos, especialmente para la formación de imágenes mediante lentes, la resolución limitada por difracción descrita anteriormente representa un escenario óptimo, alcanzado únicamente por lentes de la más alta calidad. Otros factores, como una larga lista de aberraciones ópticas comunes y la precisión con la que los fabricantes de lentes lograron reproducir la forma matemática deseada, reducen este poder de resolución. Por lo tanto, la resolución se define generalmente de forma experimental, basándose en el contraste medido a diferentes escalas de longitud, o mediante simulación y cálculo teórico, teniendo en cuenta cada elemento de la lente.

La representación matemática más común de la resolución en este caso es la función de transferencia óptica (OTF), que consta de la función de transferencia de modulación (MTF) y la función de transferencia de fase (PTF). La MTF representa la cantidad de contraste que puede ofrecer la lente o el sistema óptico en diferentes escalas de longitud o frecuencias espaciales. La PTF no se analizará aquí; la información de fase de la imagen requiere configuraciones ópticas especializadas y puede omitirse en la imagen convencional. La MTF se puede calcular para lentes y configuraciones ópticas teóricas. Sin embargo, puede ser difícil de medir en la práctica.

En cambio, para realizar pruebas en condiciones reales de componentes ópticos, se puede adoptar un enfoque más sencillo, midiendo la denominada función de transferencia de contraste (CTF, por sus siglas en inglés).

Gráficos CTF y MTF

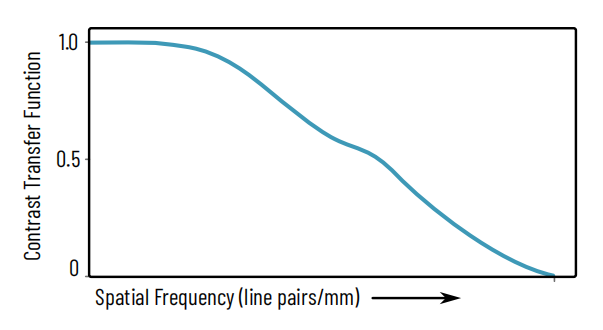

Figura 2: Ejemplo de una curva CTF

La función de transferencia de contraste (CTF) es una medida numérica de la cantidad de contraste que atraviesa un sistema óptico. Eje X: frecuencia espacial en pares de líneas/mm, que aumenta de izquierda a derecha. Las mediciones reales de CTF y MTF suelen incluir varias curvas diferentes que corresponden a distintas condiciones de medición, como líneas de referencia radiales frente a paralelas, líneas horizontales/verticales, diferentes ajustes de lente, etc.

La función de transferencia de contraste (CTF) de una lente es una función compleja influenciada por cada elemento óptico en la trayectoria óptica, y puede medirse para cada lente, el sensor de la cámara o el sistema óptico completo. La gráfica típica se muestra en la Figura 2.

El eje X se representa típicamente en «pares de líneas por mm», lo que indica la capacidad del componente probado para reproducir un par de líneas, una brillante y otra oscura, a una frecuencia espacial determinada. El inverso de este valor proporciona el grosor del par de líneas. En el eje Y se encuentra la CTF, que es la relación entre el contraste de las líneas que entran en la lente y las que salen de ella, como se muestra en la ecuación 1, donde el contraste se define como en la ecuación 2.

Factores que afectan a MTF/CTF

Por ejemplo, consideremos una secuencia de pares de líneas con líneas brillantes bordeadas por líneas oscuras cuya intensidad es solo el 20% de la de las líneas brillantes. El contraste en este caso sería del 66% según la ecuación 6. Si al pasar a través de una lente, las líneas brillantes se dispersaran por difracción y aberraciones, de modo que ahora las líneas oscuras tuvieran la mitad de la intensidad de las líneas brillantes, el contraste sería del 33%, y la CTF sería del 33%/66% = 50%. En la mayoría de los casos, cuanto mayor sea la frecuencia espacial en lp/mm, menor será la CTF, aunque la curva no siempre es monótona (disminuye suavemente).

La función de transferencia de modulación (MTF) de un objetivo de cámara típico depende de múltiples factores; por lo tanto, generalmente se representan varios gráficos para caracterizar un mismo objetivo. Entre estos factores se incluyen el tamaño de la apertura (por ejemplo, f/4, f/8, etc.), la distancia al centro del objetivo y si los pares de líneas medidas son paralelos a la cuadrícula de píxeles del sensor de la cámara, como se analiza para la resolución limitada por difracción.

En definitiva, la respuesta a la pregunta "¿esta combinación de lente y sensor ofrece la resolución suficiente para mi aplicación?" puede requerir pruebas experimentales y comparativas.

Frecuencia espacial: Medición de detalles

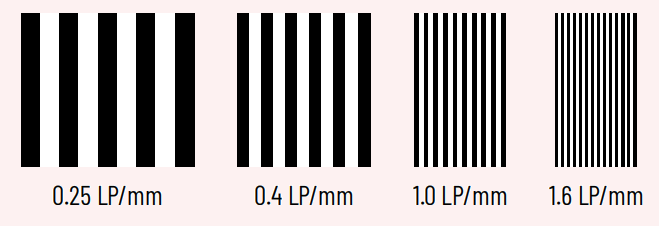

Figura 3: Ejemplo de aumento de la frecuencia espacial en pares de líneas / mm

La frecuencia espacial es un concepto comúnmente utilizado en discusiones sobre resolución. Se refiere simplemente a la cantidad de elementos por unidad de distancia, por ejemplo, un patrón repetitivo de líneas muy próximas entre sí. Generalmente se mide en unidades de distancia inversa, como m⁻¹, aunque en la práctica, los milímetros inversos (mm⁻¹) son idénticos a los pares de líneas por milímetro (lp/mm). La frecuencia espacial es directamente análoga a la frecuencia temporal de las ondas de luz o sonido, con la diferencia de que se mide por unidad de espacio, en lugar de por unidad de tiempo.

Resolución, contraste y relación señal/ruido (SNR)

Es importante recordar que los cálculos y mediciones de resolución son un escenario "ideal". La definición de resolución anterior se basa en el contraste de la imagen. Lograr el contraste necesario para resolver detalles finos depende no solo de la resolución óptica y de la cámara, sino también derelación señal/ruido(SNR), luz de fondo, calidad de la imagen y otros factores.

Cabe destacar también que los factores que mejoran la resolución óptica suelen mejorar otros factores importantes; por ejemplo, aumentar el tamaño del objetivo o la apertura de la lente del microscopio también resulta en una mayor captación de luz, lo que generalmente mejora la relación señal-ruido. De hecho, en la obtención de imágenes de fluorescencia con un objetivo de microscopio, el brillo de la luz captada depende de la apertura numérica elevada a la cuarta potencia, lo que significa que un pequeño aumento en la apertura numérica puede generar una mejora significativa en el brillo de la imagen.

Factores clave que afectan la resolución en la obtención de imágenes científicas

Más allá de los límites teóricos, la resolución práctica está determinada por varios factores interdependientes:

1. Calidad de la lente y aberraciones

● La corrección de aberraciones (lentes apocromáticas, óptica adaptativa) es esencial para obtener imágenes de alta resolución.

● Una mala calidad de la lente reduce la MTF y amplía la PSF.

2. Apertura numérica (AN)

● Los objetivos con mayor apertura numérica (NA) capturan más luz difractada y mejoran la resolución.

● La apertura numérica (NA) está limitada por el diseño físico y el índice de refracción del medio de imagen.

3. Longitud de onda de la iluminación

● Las longitudes de onda más cortas (por ejemplo, la luz azul) ofrecen una mayor resolución.

● Técnicas como la microscopía de superresolución explotan este principio manipulando los límites efectivos de la longitud de onda.

4. Características del sensor

● Tamaño del píxel: Los píxeles más pequeños pueden muestrear detalles más finos, pero solo si la óptica proporciona suficiente resolución (criterio de muestreo de Nyquist).

● Eficiencia cuántica: Una mayor eficiencia cuántica mejora la relación señal-ruido, revelando detalles más finos.

● Lectura de ruido y corriente oscura: Los sensores de bajo ruido preservan el contraste en altas frecuencias espaciales.

5. Iluminación y condiciones de la muestra

● Una iluminación desigual o débil reduce el contraste.

● La preparación, tinción o etiquetado de la muestra pueden afectar directamente la capacidad de resolver estructuras.

Conclusión

La resolución es un pilar fundamental de la imagen científica. Define la capacidad de un sistema para distinguir detalles finos, lo que repercute en todo, desde la microscopía hasta la inspección de semiconductores. Si bien los megapíxeles suelen ser la principal preocupación del público, la resolución real viene determinada por una combinación de óptica, difracción, características del sensor y factores de calidad de imagen como el contraste y la relación señal-ruido (SNR).

Al comprender conceptos como la función de dispersión puntual, la MTF, la frecuencia espacial y los límites físicos impuestos por la difracción, los investigadores pueden tomar decisiones informadas sobre los sistemas de imagen, optimizar las configuraciones experimentales e interpretar los resultados con precisión. En definitiva, dominar la resolución es esencial para obtener imágenes científicas significativas y de alta calidad.

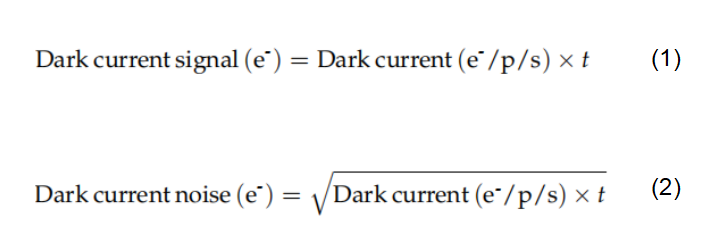

Tucsen Photonics Co., Ltd. Todos los derechos reservados. Al citar, por favor, indique la fuente:www.tucsen.com

2025/10/20

2025/10/20